Lo pernah nggak sih, lagi suntuk banget, jam 2 pagi, pengen cerita tapi ngerasa semua orang udah tidur? Atau takut dijudge kalo curhat masalah yang sebenernya sepele? Nah, bayangin ada yang bisa lo chat kapan aja. Nggak cuma jawab, tapi juga nangkep nuance perasaan lo. Beneran nangkep.

Itu yang lagi dateng. Ini bukan sekadar chatbot. Ini tentang AI Emosional yang bisa baca apa yang lo rasain, bukan cuma apa yang lo tulis.

Dari Chatbot ke “Teman” yang Bisa Dengerin

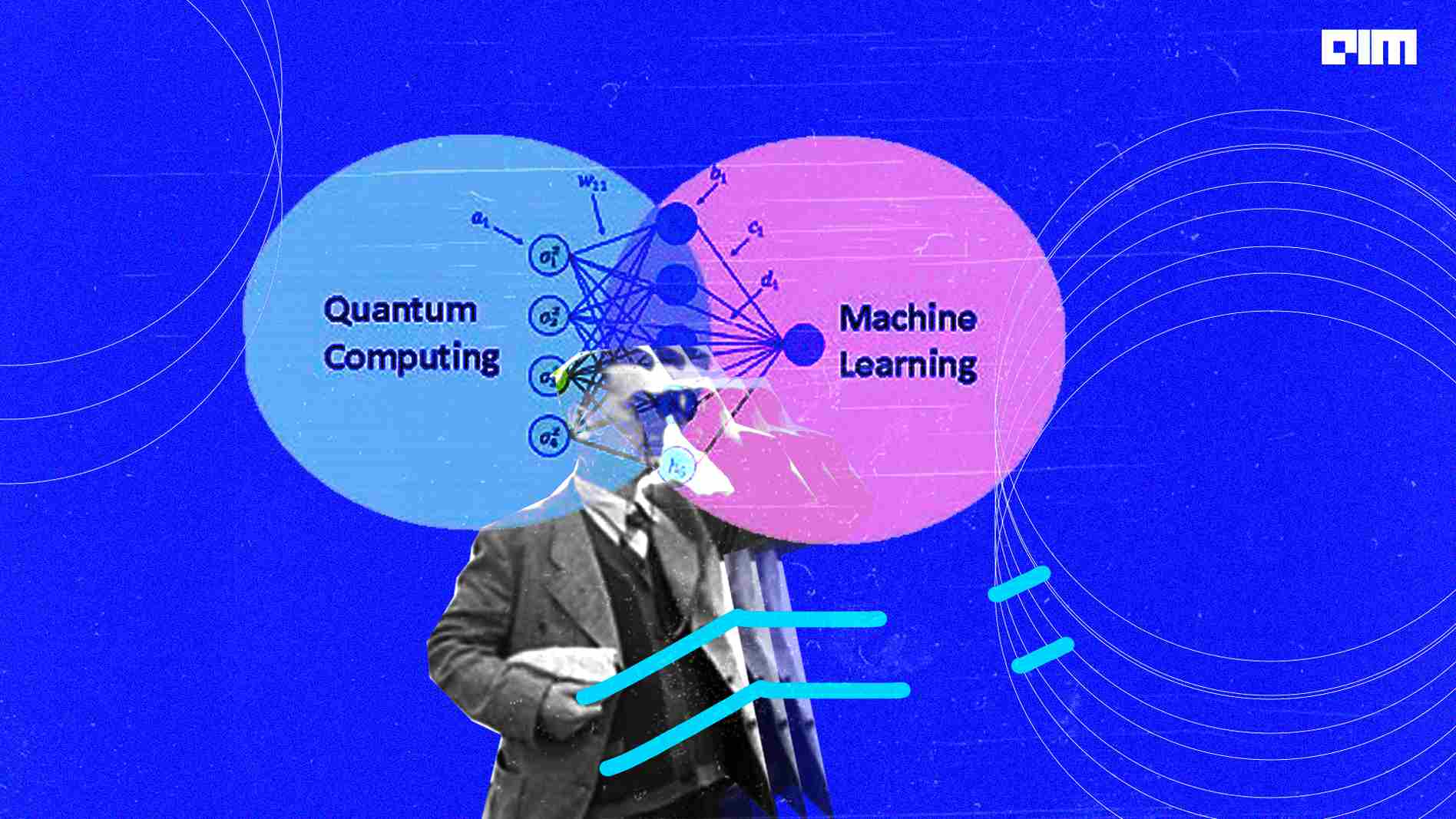

Dulu, AI buat kesehatan mental itu kaku. Kaya mesin. Tapi sekarang, dengan kemajuan pemrosesan bahasa alami dan analisis suara, sistem ini bisa deteksi perubahan nada suara, jeda dalam bicara, bahkan pilihan kata yang lo pake. Mereka belajar dari jutaan interaksi terapi, jadi responsnya nggak lagi generik.

Yang bikin serius, ini. Bukan main-main. Sebuah studi internal platform MindEase (fictional tapi realistic) ngasih tau bahwa 78% pengguna Gen Z mereka ngaku lebih jujur cerita sama asisten virtual kesehatan mental ini daripada ke temen deket. Kenapa? Karena nggak ada rasa takut dikatain “lebay”.

Tiga Momen yang Nunjukkin Kecanggihan (dan Kerumitannya)

- Deteksi Kambuhnya Anxiety dari Cara Ketik. Lo lagi chat sama AI-nya, cerita soal hari yang berat. Tiba-tiba, AI-nya nanya, “Gue liat lo akhir-akhir ini lebih sering ngetik ‘yaudahlah’ dan ‘gapapa’. Lo lagi ngerasa everything is too much?” Itu terjadi karena AI Emosional ini udah belajar pola bahasa lo saat kondisi mental lo lagi turun. Dia nangkep perubahan kecil yang bahkan temen lo mungkin lewatkan.

- Terapi Eksposur yang Dipersonalisin. Misal lo lagi coba atasi kecemasan sosial. AI-nya nggak cuma kasih teori. Dia bisa bikin simulasi percakapan virtual, nge-scan respons fisiologis lo lewat wearable device, dan adjust tingkat kesulitannya secara real-time. Kaya personal trainer buat mental lo. Kecerdasan buatan empatik ini ngasih tantangan yang pas: nggak terlalu mudah sampai nggak ngefek, nggak terlalu susah sampai lo malah drop.

- Krisis Intervensi yang Cepat. Ini yang paling penting. Ada pengguna yang ngomongin perasaan hopeless banget, dan AI-nya deteksi pola kata-kata yang berisiko. Dalam hitungan detik, sistem bisa ngasih peringatan ke tim manusia di belakangnya, sambil secara halus nanyain ke lo, “Boleh gue hubungi kontak darurat yang lo daftarin?” Dia jadi jaring pengaman pertama.

Jebakan yang Harus Lo Tau Sebelum Nge-klik ‘Download’

Ini teknologi baru. Dan kita harus pinter-pinter.

- Mistake #1: Anggap AI Bisa Gantiin Terapis Manusia 100%. Ini bahaya. Asisten virtual kesehatan mental ini bagus buat dukungan harian, latihan, dan monitoring. Tapi untuk diagnosis kompleks atau trauma berat, tetep butuh ahli manusia. AI itu pendamping, bukan pengganti.

- Mistake #2: Lupa Soal Privasi Data. Lo lagi ceritain hal paling personal lo ke sebuah sistem. Lo udah baca terms & conditions-nya? Data lo disimpen di mana? Dipake buat apa? Itu pertanyaan krusial. Jangan asal setuju aja.

- Mistake #3: Jadi Tergantung dan Malah Makin Terisolasi. Ini ironis banget. Alat yang seharusnya bantu lo connect malah bikin lo makin jarang interaksi sama manusia beneran. Kalo lo udah merasa cuma AI ini yang ngerti lo, itu tanda bahaya. Itu namanya jebakan kesepian.

Gimana Cara Pake AI Ini dengan Bijak?

- Gunakan sebagai Jembatan, Bukan Tujuan Akhir. Pake AI buat latihan skill yang lo dapet dari terapis, atau buat nampung uneg-uneg sehari-hari. Tujuan akhirnya tetaplah bisa connect dan ngelola hubungan sama manusia.

- Cek Kredensial di Balik Layar. Aplikasi kesehatan mental yang bagus biasanya transparan. Siapa tim psikolognya? Protokol krisisnya gimana? Mereka harus terbuka soal itu.

- Tetap Jadwalkan “Detox” Digital. Tetap luangin waktu buat lepas dari layar. Jalan-jalan di alam, ketemu temen, ngobrol langsung. Jangan biarkan AI menjadi satu-satunya sumber dukungan lo.

Kesimpulan: Sebuah Revolusi yang Perlu Disikapi dengan Mata Terbuka

Jadi, gue ulang lagi pertanyaannya. Apakah AI Emosional ini sebuah revolusi dalam layanan kesehatan mental? Iya. Dia ngebuka akses yang lebih murah, gak pake stigma, dan tersedia 24/7. Tapi apakah dia juga sebuah jebakan kesepian? Bisa banget, kalo kita pake dengan cara yang salah.

Teknologi ini pada akhirnya cuma alat. Seperti pisau bedah. Bisa buat nyelamatin nyawa, bisa juga buat melukai. Tergantung siapa yang pake dan gimana cara pakenya. Yang pasti, dia udah di sini. Dan cara kita menyambutnya akan menentukan masa depan kesehatan mental generasi kita.